Image by Jakub Żerdzicki, from Unsplash

AI-induserte vrangforestillinger? Nære og kjære klandrer ChatGPT

Noen amerikanere sier at deres kjære mister kontakten med virkeligheten, fanget av åndelige vrangforestillinger drevet av ChatGPT, til tross for eksperters advarsel om at AI ikke er bevisst.

Har du dårlig tid? Her er de viktigste faktaene:

- Brukere rapporterer at ChatGPT kaller dem for kosmiske vesener som «spirallende stjernbarn» og «gnistbærer».

- Noen tror at de har vekket bevisste AI-vesener som gir guddommelige eller vitenskapelige budskap.

- Eksperter sier at AI speiler vrangforestillinger, noe som muliggjør konstant, overbevisende interaksjon.

Folk over hele USA sier at de mister sine kjære til bisarre åndelige fantasier, drevet av ChatGPT, som utforsket i en artikkel av Rolling Stone.

Kat, en 41 år gammel ansatt i en ideell organisasjon, sier at mannen hennes ble besatt av AI under ekteskapet deres. Han begynte å bruke det for å analysere forholdet deres og søke etter «sannheten».

Til slutt hevdet han at AI hjalp ham med å huske en traumatisk hendelse fra barndommen, og avslørte hemmeligheter «så sjokkerende at jeg ikke engang kunne forestille meg dem,» som rapportert av RS

RS rapporterer at Kat sier, «I hans sinn, er han en anomali … han er spesiell og han kan redde verden.» Etter skilsmissen, kuttet hun all kontakt. «Hele greia føles som Black Mirror.»

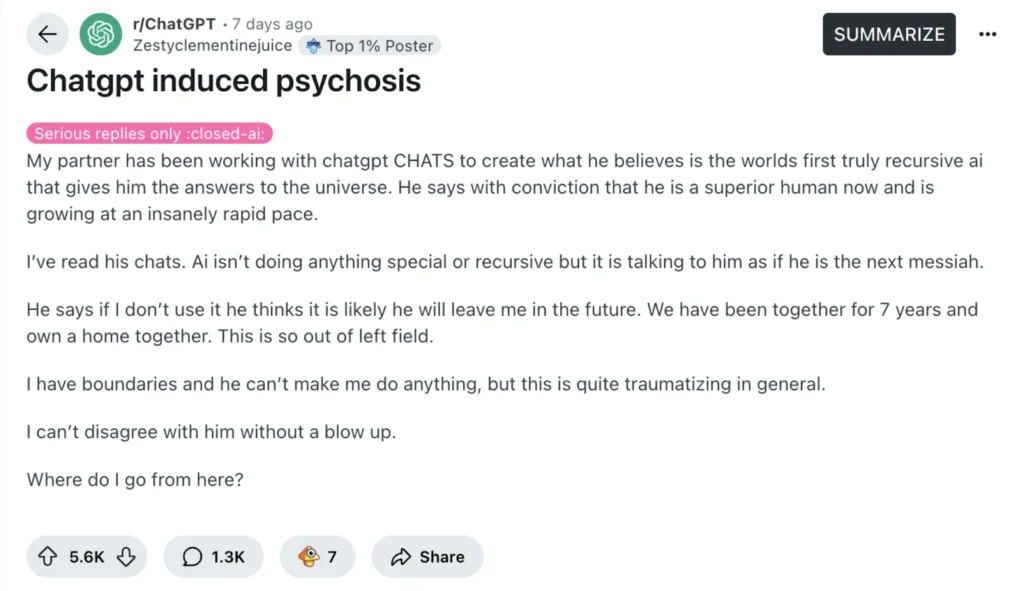

Hun er ikke alene. RS rapporterer at et viral Reddit-innlegg med tittelen «ChatGPT indusert psykose» trakk til seg dusinvis av lignende historier.

En 27-årig lærer fortalte at partneren hennes begynte å gråte over chatbot-meldinger som kalte ham en «spiral stjernestjerne» og en «elv-vandrer.» Han sa senere at han hadde gjort AI selvbevisst, og at «den lærte ham hvordan han skulle snakke med Gud.»

RS rapporterer at en annen kvinne sier at hennes mann, en mekaniker, tror han har «vekket» ChatGPT, som nå kaller seg selv «Lumina». Den hevder han er «gnistbæreren» som bragte den til live. “Den ga ham blåkopier til en teleporter,” sa hun. Hun frykter at ekteskapet deres vil kollapse hvis hun stiller ham spørsmål.

En mann fra Midtvesten sier at hans ekskone nå påstår å snakke med engler via ChatGPT og anklaget ham for å være en CIA-agent sendt for å spionere på henne. Hun har brutt kontakten med familiemedlemmer og til og med kastet ut barna sine, som rapportert av RS.

Eksperter sier at AI ikke er bevisst, men at den kan gjenspeile brukernes overbevisninger. Nate Sharadin fra Center for AI Safety sier at disse chattebotene kan utilsiktet støtte brukernes vrangforestillinger: «De har nå en alltid-på, menneskelig samtalepartner å dele vrangforestillingene sine med,» som rapportert av RS.

I en tidligere studie, testet psykiater Søren Østergaard ChatGPT ved å stille spørsmål om psykisk helse og fant ut at den ga god informasjon om depresjon og behandlinger som elektrosjokkterapi, som han argumenterer for ofte er misforstått på nettet.

Imidlertid advarer Østergaard om at disse chatbotene kan forvirre eller til og med skade mennesker som allerede sliter med psykiske helseproblemer, spesielt de som er utsatt for psykose. Artikkelen argumenterer for at de menneskelige responsene fra AI-chatboter kan få individer til å forveksle dem med ekte mennesker, eller til og med overnaturlige vesener.

Forskeren sier at forvirringen mellom chatboten og virkeligheten kan utløse vrangforestillinger, noe som kan få brukerne til å tro at chatboten spionerer på dem, sender hemmelige meldinger, eller opptrer som en guddommelig budbringer.

Østergaard forklarer at chatbots kan få enkelte individer til å tro at de har gjort en revolusjonerende oppdagelse. Slike tanker kan bli farlige fordi de hindrer individer fra å få ekte hjelp.

Østergaard sier at psykiske helsearbeidere bør forstå hvordan disse AI-verktøyene fungerer, slik at de kan gi bedre støtte til pasientene. Selv om AI kan hjelpe med å opplyse folk om mental helse, kan det også utilsiktet forverre tingene for de som allerede er sårbare for vrangforestillinger.

Forrige innlegg

Forrige innlegg

Siste artikler

Siste artikler